|

|

アバタロボットを用いたテレイマージョン技術の開発補助事業

公益財団法人JKA補助事業 2022年度 競輪補助事業 (2022.4-2024.3)

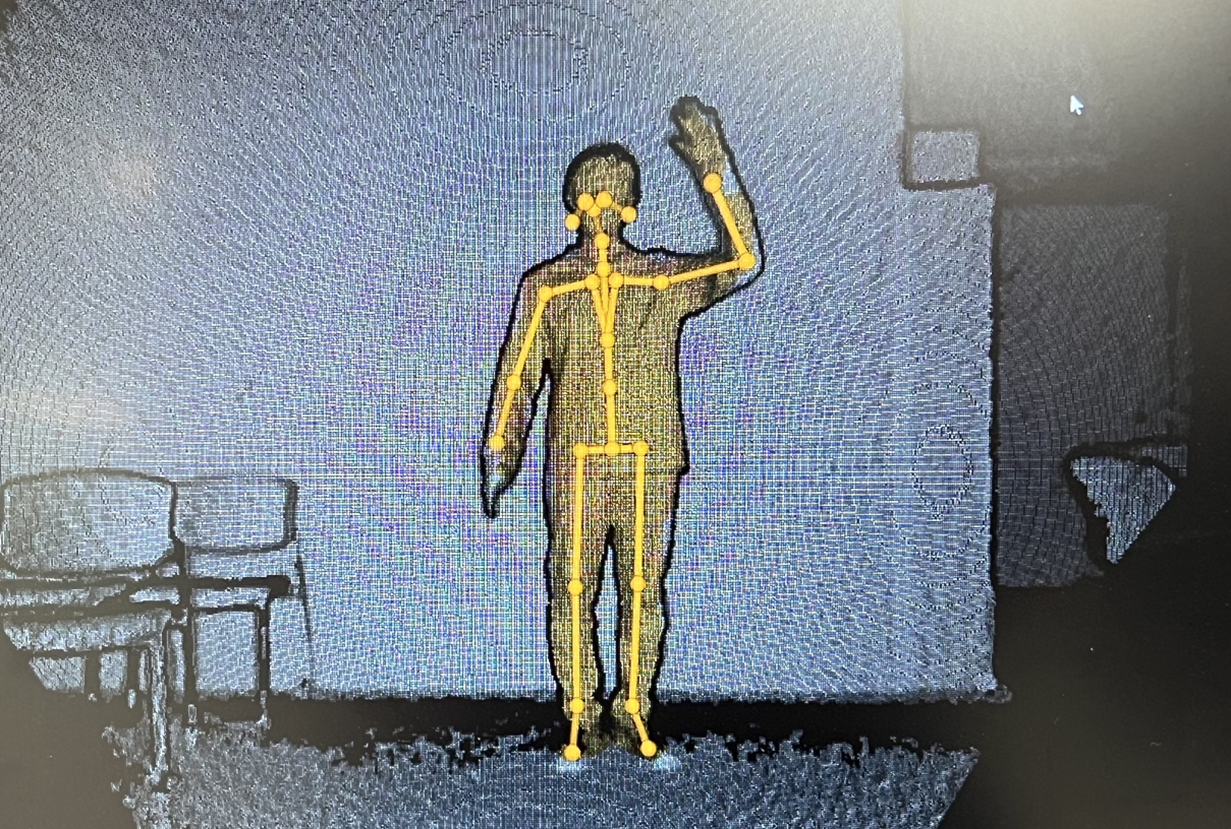

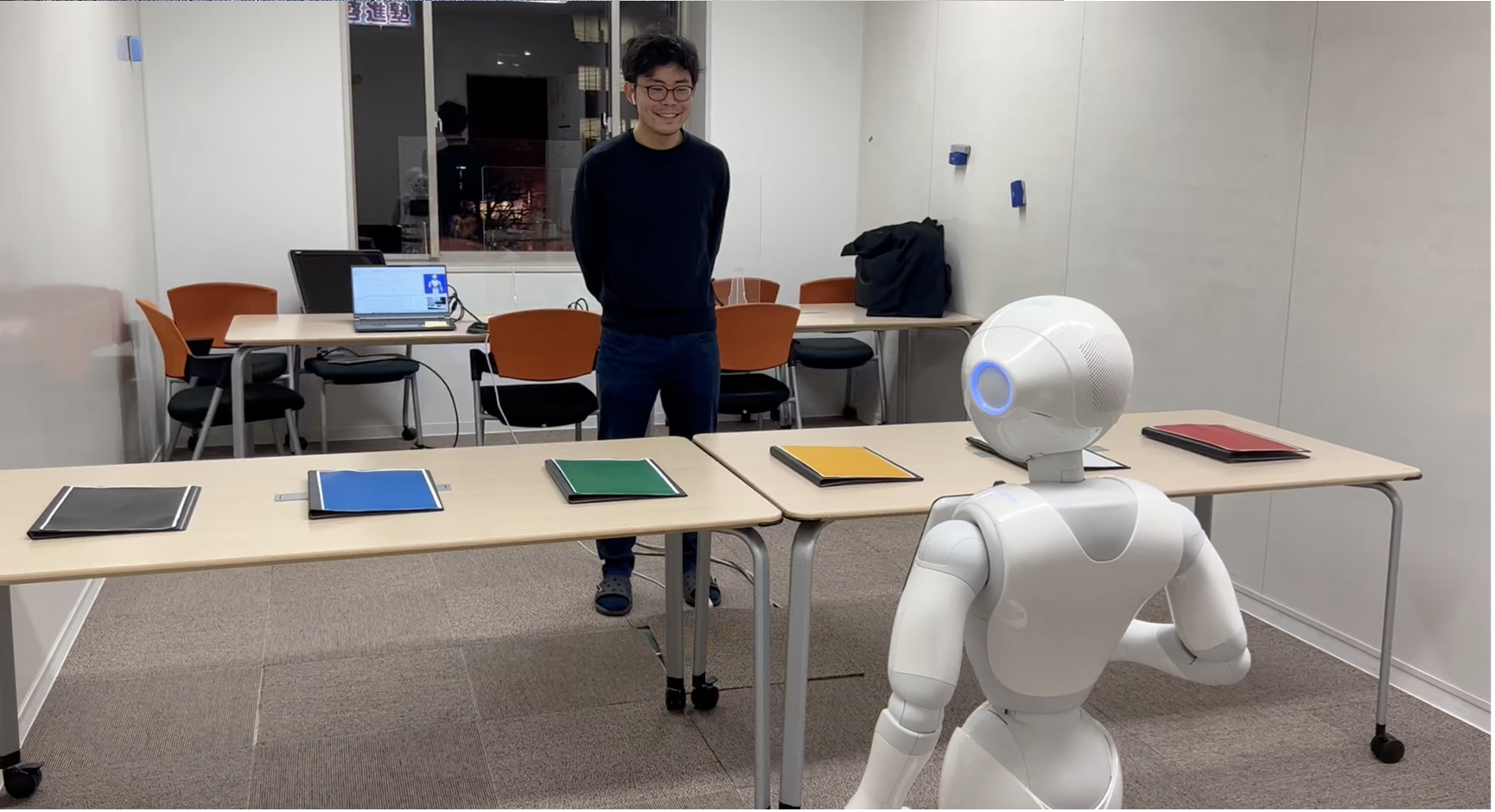

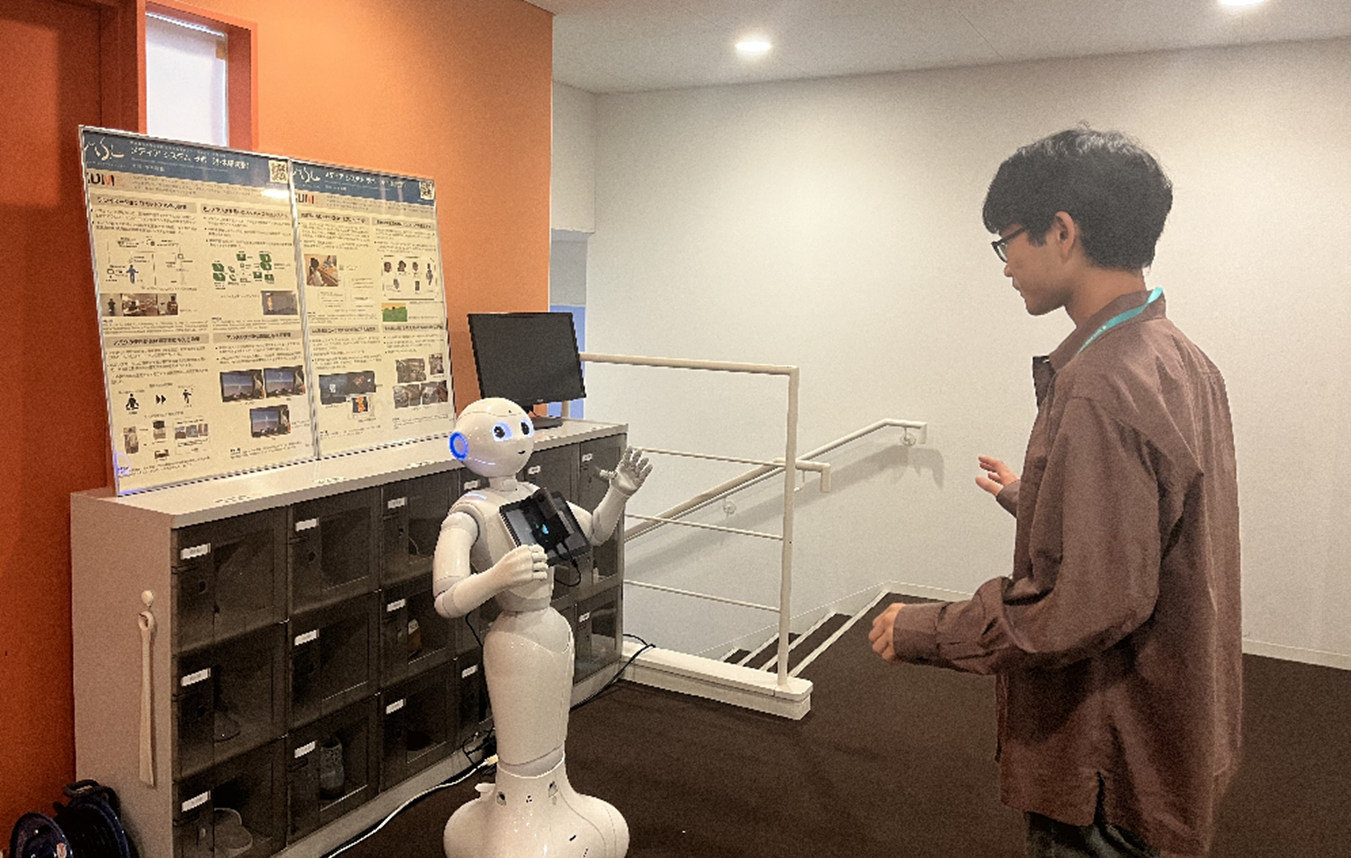

■ 研究概要

■ 発表論文

・Yuki Kida, Kei Matsuoka, Tetsuro Ogi: Necessary Requirements of Avatars for Remote Communication in Real Space, The 25th International Conference on Network-Based Information Systems (NBiS 2022/INVITE 2022), pp.354-364, Osaka (Online), 2022. (pdf)

・木田勇輝、李書界、高柳直歩、上田雄斗、松岡慧、小木哲朗:ロボットアバタを用いた没入型テレイマージョンシステムの構築、第49回テレイマージョン技術研究会、福江、2023.

・Yuki Kida, Kei Matsuoka, Tetsuro Ogi: Evaluation of Conveying Spatial Information by Pointing Gestures of a Tele-immersion Robot Avatar, International Conference on Design and Concurrent Engineering 2023 & Manufacturing Systems Conference 2023 (JSME iDECON/MS2023), Yokohama, 2023. (pdf)

・Yuki Kida, Shujie Li, Yuto Ueda, Naoto Takayanagi, Kei Matsuoka, Tetsuro Ogi: Evaluation of User’s Psychological Sense in Tele-Immersion Robot Avatar, The 26th International Conference on Network-Based Information Systems (NBiS 2023/INVITE 2023), pp.325-333, Chiang Mai, 2023.(pdf)

・小木哲朗、宮地英生、江原康生、石田智行:テレイマージョン×コミュニケーション、第28回日本バーチャルリアリティ学会大会論文集、1B3-01、東京、2023. |

|

|

|

|

|